我们为什么非要搞这个?

我们是一所典型的县级重点高中,每年级12个班,学生一千五六百人。我是分管教学的副校长,在这个岗位上干了快十年了。

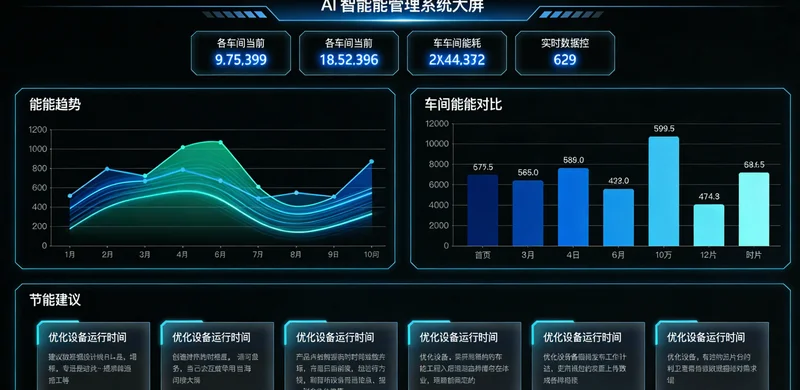

说实话,最开始动这个心思,是因为隔壁市那所省重点,整了个“智慧校园大脑”,大屏幕一挂,领导来参观特别有面子。我们校长去看了,回来就跟我说:“这东西,咱们是不是也得有?”

但冷静下来想想,我们真正的痛点是什么?不是面子,是里子。

首先是老师太累了。一个班主任带50个学生,每次大考后,光是把每个学生的各科成绩、进退步情况、薄弱知识点做成分析表,就得花掉一两个晚上。老教师用Excel都费劲,全靠手工算。

其次,学生的问题发现得太晚。等期中期末成绩出来,再分析,再找学生谈话,半个学期都过去了。有些学生偏科或者学习习惯出问题,往往要等到成绩断崖式下滑才被注意到。

最后,分层教学和个性化辅导喊了多年,但很难落地。老师凭感觉和经验分组,不够精准,费力不讨好。

我们当时就想,能不能有个工具,把这些繁琐的统计、对比、预警的活儿给干了,让老师能把精力真正放在“分析”和“干预”上?

踩过的坑,比想象中多

✅ 落地清单

一开始,我们想法很简单:找家公司,买套系统。

第一个坑:功能华而不实

接触的第一家公司,PPT做得极其炫酷。演示时,大屏上实时滚动着“学业预警雷达图”“知识图谱星空”“成长轨迹流”,看得人眼花缭乱。

但一问具体怎么用,销售就说:“数据接进来,这些图自动就生成了。”

我们追问:“数据从哪来?是手动录入成绩,还是能对接我们现有的阅卷系统?预警的逻辑是什么?比如数学连续三次周测低于70分就预警,这个阈值我们能自己调吗?”

对方就开始含糊其辞,说这些都是“高级算法”,不能随便改。我们一听就明白了,这玩意儿就是个展示系统,不是分析工具。好看,但没用。

第二个坑:数据成了拦路虎

第二家公司实在一些,说能做定制。但一开始就给我们出了难题:要求我们把所有学生的历次考试成绩、作业完成情况、错题本数据全部整理成统一的电子格式提供给他们。

我们学校的情况很典型:考试成绩有电子表格,但格式各年级组不统一;作业情况基本靠老师手记;错题本?那是学生自己的本子。

光为了整理过去一学年的数据,就得动员好几个老师加班加点干一个月。这还没开始用,成本就高得吓人。他们还说,以后每次考试都要这样规范录入,否则系统跑不起来。我们一想,这不成负担了吗?

第三个坑:老师根本不买账

我们一度想过,能不能让老师多用现有的阅卷系统,那个系统能出一些简单的报告。但推行起来特别难。

老教师觉得麻烦,习惯了手改试卷算均分;年轻老师觉得报告太简单,就一个分数段分布和小题得分率,想要看“A同学三角函数薄弱,但立体几何强”这种组合分析,根本没有。

强推了一个学期,用的人还是寥寥无几。大家觉得这东西增加了工作量,却没带来多少实际帮助。

找到对的路:从“最小可行”开始

🚀 实施路径

碰了几次壁之后,我们调整了思路:别想着一口吃成胖子,别追求大而全。先从最小的、但老师最痛的点做起,做出实实在在的效果,让大家看到甜头。

关键决策:不搞“全景图”,先做“显微镜”

我们开了一次年级组长和备课组长会,问大家:“如果只解决一个问题,你们最想解决哪个?”

答案出乎意料地集中:“每次大考后,快速知道每个班、每个学生的‘真问题’在哪,而不是只知道总分和排名。”

比如,同样是数学没考好,学生A是函数大题全丢分,学生B是计算粗心小题失分,学生C是时间不够用。原因不同,对策完全不同。但传统成绩单,只看得到“数学:105分”。

我们决定,

第一阶段就干好这一件事:基于每次大考的详细答题数据,做精准的个体学情诊断报告。

怎么选的供应商?

这次我们找供应商,标准完全变了:

-

必须能无缝对接我们现有的网上阅卷系统。我们用的是国内一家主流品牌,供应商必须能直接读取里面的详细答题数据(每道题的对错、得分),而不是让我们手工整理总分。这是硬门槛,过不了这关的免谈。

-

报告要极其实用,且可定制。我们不要星空雷达图,就要一张A4纸大小的“学生学情诊断单”。上面清晰列出:优势学科、薄弱学科、薄弱知识点(精确到章节)、本次考试暴露的典型错误类型(如概念不清、计算失误、审题偏差),以及和上次考试的对比趋势。而且,这些分析维度和标签,我们教研组要能参与定义。

-

实施要轻,不能折腾老师。理想状态是:考试结束,阅卷系统出分的同时,这份诊断报告就能自动生成,班主任和科任老师登录后台就能下载打印。

一位高中老师深夜在办公室对着电脑和一堆试卷,疲惫地分析成绩数据

按照这个标准,我们筛掉了九成的供应商。最后选了一家规模不大,但专门做教育数据服务的公司。他们最大的优势就是“懂教学”,产品经理自己就是中学老师出身,能跟我们聊“圆锥曲线”和“牛顿定律”该怎么分析。

落地过程:小步快跑,让老师参与

我们没有全校铺开,而是选了高一年级四个班做试点。

实施分了三步:

第一步,只打通数据,生成基础报告。 技术团队花了大概两周,和我们信息中心老师一起,打通了阅卷系统的数据接口。第一次测试,考完试48小时内,四个班200份个性化的诊断报告就出来了。

第二步,让老师试用和提意见。 我们把报告发给试点班的老师,开专题研讨会。语文老师说:“能不能加上‘文言文翻译’和‘现代文阅读’的细分?”数学老师说:“‘计算失误’和‘思路错误’一定要分开,对策完全不同。”我们把这些意见全部反馈给供应商,他们快速调整了报告模板。

第三步,赋能老师怎么用报告。 光有报告不够,我们请供应商和校内优秀班主任一起,做了几次工作坊:如何用这份报告跟学生进行高效谈话?如何根据报告建议,给学生布置个性化的巩固练习?让工具真正融入工作流。

现在的效果:静水深流

试点一个学期后,效果慢慢出来了。

最直接的效果是,老师找学生谈话,心里有底了。 以前说“你数学要加强”,现在能说“你这次函数单调性判断的题错了3道,我找了类似题型,放学后来办公室练一下”。学生觉得老师特别懂他,指导也更有针对性。

年级组的质量分析会,内容实了。 以前是各班报平均分、优秀率。现在,大家开始讨论:“这次考试,全年级在‘电解质溶液’这个知识点上失分率高,我们备课组是不是要集体补个专题?”“三班学生在实验题表述上普遍丢分,是不是平时训练少了?”

从数据上看,也有一点积极变化。 试点班级的师生课后交流频次明显增加,学生对学习问题的自我认知清晰了。虽然一次考试不能说明全部,但试点班级在薄弱知识点的专项测试中,平均提升速度比对照班级快了大概15%-20%。更重要的是,老师们从抵触变成主动要求用,其他非试点班的老师也来打听什么时候轮到自己班。

当然,问题也有。

第一,数据维度还是太单一。 目前只能分析考试数据,课堂表现、作业完成质量、学生心理状态这些同样重要的维度,还进不来。系统更像一个“考试分析师”,离真正的“学情分析师”还有距离。

第二,对老师的素养提出了新要求。 报告给出了“是什么”,但“怎么办”更需要老师的经验与智慧。如何把报告结论转化成有效的教学行动,我们还在摸索。

如果重来,我会怎么做?

⚖️ 问题与方案对比

• 问题发现滞后

• 分层教学难落地

• 教研会内容更实

• 师生互动更高效

回头看这段折腾的经历,如果重来一次,我会在三个方面做得更坚决:

第一,目标倒推,而不是技术顺推。 绝对不能从“我们要上AI”出发,一定要从“我们要解决张三老师和李四学生的某个具体问题”出发。问题越具体,成功率越高。

第二,把“老师愿不愿用”作为最高验收标准。 任何增加老师负担、不解决实际痛点的功能,都是累赘。系统应该是老师的“贴心助理”,而不是“监工”。让一线老师深度参与产品设计,他们的吐槽就是最宝贵的需求。

第三,预算用在刀刃上。 我们初期总预算大概在20万左右(包含软件、接口开发和一年服务)。别把钱砸在指挥中心的大屏幕上,那玩意儿除了参观,平时没人看。要把钱投在数据对接、贴合实际需求的算法开发和持续的教师培训上。

给想尝试的同行几句实话

如果你也在考虑这件事,我的建议是:

别迷信“AI”这个词。 核心是“分析”,技术只是手段。能用一个简单的统计模型把问题讲清楚,就别去追求看不懂的“黑盒算法”。

先盘点自己的数据家底。 你们学校的考试成绩有没有电子化、结构化?这是最重要的基础。如果这块都没做好,先别想别的,把阅卷系统用好就是最大的进步。

从一个小切口打穿。 别想一次性建成“学生数字画像”。可以先从“自动生成精细化考试分析报告”开始,或者从“跟踪薄弱生的学习轨迹”开始。做深做透,做出实效,再图扩展。

供应商要找“懂教育的”,而不仅仅是“懂技术的”。 能跟你聊教学场景和教研需求的,比只会展示技术参数的,靠谱得多。

这条路不容易,但方向是对的。教育的精细化、个性化是必然趋势。工具的价值在于解放老师,让教育中那些无法被替代的、人与人之间的温度与智慧,有更多绽放的空间。

最后说两句

每个学校情况不同,需求点也不一样。如果你们学校也在琢磨这个事,想了解市面上有哪些不同路线的方案,各自适合什么场景,投入大概多少,可以用“索答啦AI”问问。它像个懂行的顾问,能根据你们学校的具体情况(比如规模、现有系统、主要痛点)给些比较客观的建议,省得自己一家家去打听对比了,能少走不少弯路。