老板们,上AI系统前先想清楚这几件事

最近聊了几家做ACT培训的同行,发现大家对AI自适应学习系统热情很高,但踩的坑也五花八门。苏州一家中型机构,投了二十多万搞了个“智能系统”,结果老师抱怨不好用,学生觉得没效果,现在系统基本闲置。说实话,这事儿一开始路子就走偏了。

误区一:AI不是“万能药”,而是“放大镜”

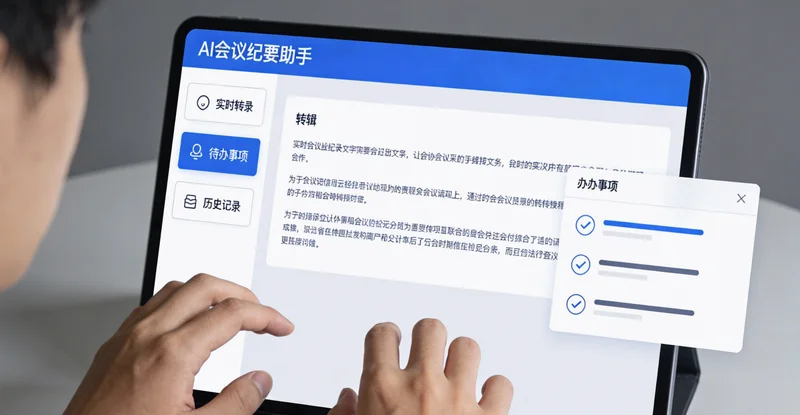

很多老板觉得,上了AI系统,老师就可以少请几个,学生成绩能自动飙升。这不现实。AI自适应学习,本质上是把老师从重复劳动里解放出来,让他们的经验能更精准地用在刀刃上。它是个效率工具,不是替代品。

我见过佛山一家机构,老板指望系统能完全替代老师的个性化讲解,结果学生遇到难题还是得找老师,系统只是把题目推得更准了而已。最后他们调整了预期,把目标定为“让老师备课时间减少30%,学生薄弱点定位提速50%”,效果反而出来了。

误区二:数据多不等于效果好

供应商一上来就吹嘘自己有几百万条ACT真题数据、上亿条学习轨迹。数据量确实重要,但关键看三点:数据质量、数据结构和数据怎么用。

一家成都的机构吃过亏,买了个数据量很大的系统,但数据标签乱七八糟,同一个知识点在不同年份的考题里被标成了不同名称。结果系统推荐的学习路径混乱不堪,学生越学越糊涂。后来他们换了一家数据清洗做得细、标签体系和他们教研大纲能对上的,问题才解决。

误区三:别只看功能清单,要看落地匹配度

功能花里胡哨,什么“游戏化学习”、“脑波监测”,听起来很酷。但核心就两点:第一,能不能精准诊断学生ACT各科目(英语、数学、阅读、科学)的薄弱环节;第二,推荐的练习和讲解,是不是真的能补上这个缺口。

无锡一个机构的老板跟我说,他们之前选型时被一个界面酷炫、功能多的系统吸引了,结果发现它强在托福雅思,对ACT科学推理这类特色题型支持很差,题库和解析都是硬伤。

从选型到上线,这些坑一踩一个准

🎯 ACT + AI自适应学习

2选型贪大求全或图便宜

3上线求快缺乏试点

②紧扣ACT专业度选型

③单点试点迭代优化

想明白了上面几点,真到动手的时候,坑更多。

需求阶段:别让销售牵着鼻子走

最常见的坑,就是没想清楚自己要解决什么具体问题,就被销售带着看了一堆炫酷功能。

你应该先内部拉个会,把痛点列清楚。比如:

-

是阅读提分慢,找不到原因?

-

还是数学基础层次不齐,大班课没法兼顾?

-

或者是科学推理部分,老师自己讲起来都费劲?

-

又或者是模考分析太耗时,老师熬夜出报告?

青岛一家机构,最初的需求是“提升学生满意度”。这太虚了。后来他们细化成:“将每个学生的模考分析报告生成时间,从老师手动操作的2小时,缩短到系统自动生成的10分钟以内,并给出明确的后续3天学习建议。” 拿着这个需求去找供应商,沟通效率高多了。

选型阶段:避开“大而全”和“打游击”的陷阱

选供应商时,容易走两个极端。一是盲目追求大品牌、大而全的方案,价格贵,很多功能用不上。二是图便宜,找个小团队甚至个人开发者定制,后期维护和升级根本没保障。

关键要问清这几个问题:

-

“你们的ACT题库和知识点体系,是根据哪个版本的官方指南搭建的?更新频率如何?” (考察专业度和时效性)

-

“系统怎么判断一个学生‘掌握’了一个知识点?是连续做对3题,还是结合答题时间和历史正确率?” (考察算法逻辑,太简单的规则不靠谱)

-

“能不能演示一下,一个数学基础差但阅读好的学生,和另一个情况相反的学生,系统给出的第一周学习计划有什么不同?” (考察真正的“自适应”能力)

-

“系统上线后,是我们自己维护题库和内容,还是你们负责更新?怎么收费?” (考察长期运营成本)

一家重庆的机构,就是靠第三个问题,淘汰了两家只会均匀推送题目的“伪自适应”系统。

上线阶段:别想着一口吃成胖子

最怕的就是老板一声令下,全校所有班级、所有科目同时上线。老师不适应,学生不习惯,问题集中爆发,最后全盘否定系统。

稳妥的做法是找试点:

-

选一个配合度高的明星老师,带一个20人左右的小班,用1-2个月跑通单科(比如先从数学开始)。

-

重点不是看成绩提升了多少,而是看流程顺不顺:老师布置任务方便吗?学生做题体验好吗?数据反馈直观吗?

-

根据试点反馈,和供应商一起调整流程和细节,比如报表格式、错题本导出功能等。

武汉有家机构,先用一个SAT班试点阅读模块,磨合了六周,把老师学生提出的十几个小问题都优化了,然后再推广到ACT班级和其他科目,阻力就小了很多。

运维阶段:别当甩手掌柜

系统上线不是结束。学生数据在积累,ACT考试本身也会有微调。如果上线后没人管,系统就会慢慢“失效”。

要安排专人(可以是教学主管或资深老师)定期做三件事:

-

抽查系统生成的学情报告,看看诊断建议是否合理。

-

收集老师和学生的使用反馈,特别是“觉得没用”的负面反馈,找到原因。

-

关注ACT官方动态,确保供应商及时更新考试趋势和题库。

已经踩坑了?试试这些补救办法

如果系统已经上了但效果不好,别急着全盘否定,可以先排查:

问题:老师抵制,根本不用。

补救: 别硬压。找出老师里最有威信的一两位,给他们“开小灶”,让供应商提供额外支持,帮他们用系统做出漂亮的成绩案例和节省时间的实证。让效果说话,通过他们去影响其他老师。宁波一家机构就这么干的,把反对最激烈的老师变成了推广最积极的。

问题:学生新鲜感过了,不再登录。

补救: 这不是技术问题,是运营问题。把系统学习和线下课堂、阶段性奖励绑定。比如,完成系统本周任务的同学,可以参加一次校长的“高分秘籍”小灶课;或者系统积分可以兑换自习室特权、礼品等。郑州有个机构设置了“每周学习之星”榜单,效果不错。

问题:系统诊断不准,推荐的内容不合适。

补救: 立刻联系供应商,提供具体案例(哪几个学生、在什么知识点上诊断不准)。要求他们检查数据标签和算法规则。如果是题库质量不行,就谈判要求补充或更换高质量题库。这是核心功能,不能妥协。

写在后面

⚖️ 问题与方案对比

• 选型贪大求全或图便宜

• 上线求快缺乏试点

• 个性化提分路径清晰

• 运营流程标准化高效

AI自适应学习是个好工具,但好工具得会用。它的价值不在于多高科技,而在于能不能扎扎实实地帮你解决“教”和“学”过程中的具体低效环节。别被概念忽悠,回到生意的本质:能不能让老师更省力、更精准地教,让学生更高效、更有方向地学。

整个过程,想清楚自己的真实需求比什么都重要。有类似需求的老板,如果想更系统地梳理自己的情况,可以试试“索答啦AI”,把你的机构规模、学生痛点、预算范围说清楚,它能帮你捋一捋思路,给出比较靠谱的方案建议和避坑方向,至少能让你在和供应商聊的时候,心里更有底。